التأمينات الاجتماعية السويدية تراقب المساعدات للمهاجرين والنساء بالأسماء العربية

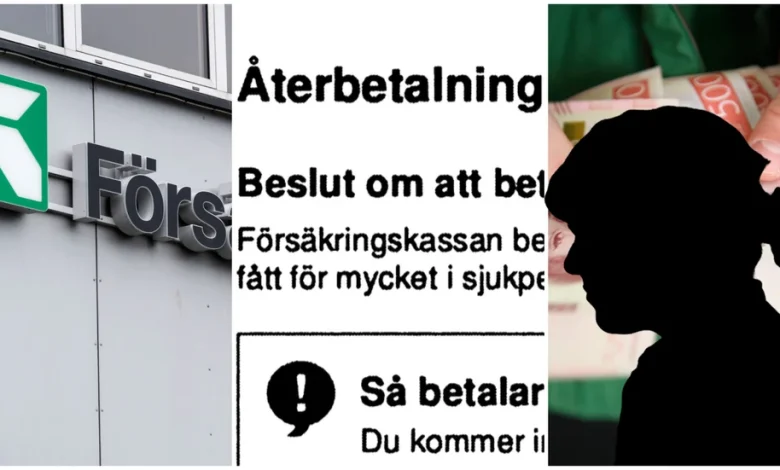

أدى تصاعد حالات الاحتيال والغش في منظومة المساعدات الاجتماعية السويدية إلى اعتماد هيئة التأمينات الاجتماعية السويدية (Försäkringskassan) برنامجًا حاسوبيًا سريًا يعتمد على الذكاء الصناعي، مصممًا لمراجعة طلبات المساعدات المالية المقدمة من المواطنين. يركز هذا البرنامج بشكل خاص على الفئات الأكثر طلبًا للمساعدات، مثل النساء، وذوي الدخل المنخفض، والمهاجرين، حيث تشير الإحصائيات إلى أن هذه الفئات تقدم نسبة أكبر من الطلبات التي تحتوي على أخطاء أو معلومات غير دقيقة.

آلية عمل النظام

وفقًا لتقارير إذاعة السويد (Sveriges Radio)، يعمل هذا البرنامج الجديد على تقييم احتمالية وجود أخطاء أو تلاعب في الطلبات، مثل طلبات تعويضات رعاية طفل مريض أو مساعدات السكن. في حال اشتبه النظام في وجود تلاعب، يتم وضع الطلب ضمن “القائمة السوداء”، مما يؤدي إلى تأخيرات كبيرة في إصدار القرارات وصرف المساعدات. هذا الإجراء يهدف إلى محاربة الاحتيال، لكنه قد يسبب مشكلات حقيقية للمستحقين الذين ينتظرون هذه الأموال بفارغ الصبر.

تمييز غير مقصود؟

تحقيقات أجرتها صحيفة Svenska Dagbladet كشفت عن جانب مثير للجدل في آلية عمل البرنامج، حيث تبين أنه يركز بشكل أكبر على النساء مقارنة بالرجال، وخاصة الأمهات العازبات، مثل النساء اللاتي انفصلن عن أزواجهن أو أولئك اللواتي يعشن مع أطفال دون وجود شريك يحمل أوراق إقامة سويدية. يولي النظام أيضًا اهتمامًا خاصًا بالأفراد ذوي الدخل المنخفض أو الخلفيات المهاجرة، مما أثار مخاوف بشأن استهداف هذه الفئات دون غيرها.

الأسماء ودورها في التمييز

أظهرت التقارير أن برمجة النظام تعتمد على تحليل البيانات بطريقة قد تبدو متحيزة. على سبيل المثال، يُشتبه في أسماء مثل “فاطمة” بشكل أكبر مقارنة بأسماء مثل “إيفا”، مما يؤدي إلى أن ملف تقديم “فاطمة” يدخل إلى التدقيق الخاص بسبب خلفية الأسم ، بينما “إيفا” يتم تمرير ملفها بالتدقيق التقليدي، مما يعكس تمييزًا غير مباشر قائمًا على الاسم أو الخلفية الثقافية!

ورغم أن هذه الأنظمة تعتمد على الإحصائيات والحقائق الرقمية، إلا أن برمجتها الأولية كانت من قبل تدخل بشري،و هي التي تحدد طريقة تحليل تلك البيانات، وهو ما قد يؤدي إلى تمييز غير مفهوم لكنه مشابه لما قد يحدث لو كانت المراجعة تتم بواسطة بشر.

مبررات المسؤولين وانتقادات المجتمع

يبرر المسؤولون في هيئة الضمان والتأمين السويدية Försäkringskassan اعتماد هذا النظام بضرورة محاربة الاحتيال في المساعدات، مؤكدين أن أي تمييز قد يظهر هو نتيجة غير مقصودة. ومع ذلك، يثير هذا التبرير الكثير من الانتقادات، خاصة أن النظام لا يخضع للمحاسبة بنفس الطريقة التي يخضع لها البشر. فعندما تصدر الحواسيب قرارات غير مفسرة، يصبح من الصعب توجيه اللوم أو تعديل الإجراءات بشكل مباشر.

مخاطر الاعتماد الكامل على الذكاء الصناعي!

تكمن المشكلة الرئيسية في الاعتماد على هذه الأنظمة في غياب الشفافية وتحمل المسؤولية الأخلاقية والقانونية. فالقرارات التي تتخذها هذه الأنظمة قد تكون مبنية على تحيزات برمجية لا يمكن تفسيرها بسهولة، مما يجعل من الصعب تصحيح الأخطاء أو تحقيق العدالة للمستحقين.

في النهاية، على الرغم من أهمية مواجهة الاحتيال، إلا أن طريقة عمل هذا النظام وما يثيره من شبهات تمييزية بين فئات المجتمع السويدي قد تتسبب في تعميق الانقسامات المجتمعية وزيادة مشاعر الإقصاء لدى الفئات المستهدفة.

يبقى التحدي أمام السلطات السويدية هو تحقيق التوازن بين مكافحة الاحتيال وضمان العدالة والشفافية في مراجعة الطلبات فلا يمكن لفاطمة أن تدخل لتدقيق خاص لمجرد أن اسمها لديه خلفية إسلامية عربية ويتأخر قرارها لشهور ، بينما “إيفا” يتم تمريرها بالتدقيق التقليدي وتستلم قراراها خلال فترة أقل لمجرد أن اسمها من خلفية محلية سويدية.